TEST Dolby Vision vs HDR10 na LG OLED (z Ultra HD Blu-ray)

Technologia HDR to najciekawszy i zarazem najistotniejszy element całego standardu Ultra HD. Na nowo zdefiniowane poziomy jasności dają potężne doznania wizualne względem obrazu SDR. Dużo większe niż sama rozdzielczość 4K, czy poszerzona paleta barw. Osoby, które kliknęły w pierwszy odnośnik wiedzą już, że samo słowo HDR oznacza jedynie pewną koncepcję, nie zaś metodę jej realizacji. Jeśli mowa o konkretnych metodach, to należałoby tu wyszczególnić przede wszystkim HDR10 (czyli bazowy standard, z którym każde urządzenie jest zgodne), oraz Dolby Vision, czyli bogatszą technologię, mogącą dostarczyć potencjalnie lepszy obraz. Tą z kolei wspierają tylko wybrani producenci, np. LG, czy Sony. Na rynku są obecnie też inne rozszerzone normy, takie jak HDR10+ (artykuł, Samsung, Panasonic), czy Technicolor (LG), jednak tylko w Dolby Vision mamy wiele treści dostępnej na wyciągnięcie ręki. Pierwsze porównanie technologii Dolby Vision do HDR10 mamy już za sobą. Dokonaliśmy go przy okazji premiery serialu Stranger Things 2 w Dolby Vision z Netflix’a. Dziś przyszedł czas na zgłębienie tematu przy użyciu nośnika zapewniającego najwyższą możliwą jakość w warunkach domowych – płyty Ultra HD Blu-ray.

Dlaczego wciąż naszym zdaniem to właśnie nośnik fizyczny zapewnia najlepszą jakość? Ponieważ plik wideo na płycie Ultra HD cechuje się znacznie niższym stopniem kompresji, niż w streamingu (np. Netflix czy YouTube) i co za tym idzie, zapewnia dużo lepsze wrażenia wizualne. Technicznie rzecz ujmując płyta może posiadać bitrate (strumień danych) nawet do 128Mbps co w stosunku do transmisji z Internetu (10 – 20Mbps) pozwala oddać wielokrotnie więcej detali w lepszej jakości. Dokonując takiego porównania mamy pewność, że wyciskamy maksimum z każdej technologii!

By porównanie były jak najbardziej obiektywne zaopatrzyliśmy się w dwa odtwarzacze OPPO UDP-203eu, które jako jedyne wspierają obecnie Dolby Vision. Jest też w prawdzie odtwarzacz LG (UP970), jednak niestety nie w polskiej dystrybucji a dodatkowo ma on dopiero dostać wsparcie DV w przyszłości jako update systemu. Do testów oczywiście niezbędne były też filmy. W dzisiejszym tekście skupimy się przede wszystkim na Szybcy i wściekli 8, oraz Power Rangers. Informacje o tym, że zostały w standardzie Dolby można znaleźć na odwrocie pudełka, ale bardzo małym druczkiem.

Technicznie o różnicach Dolby Vision vs HDR10

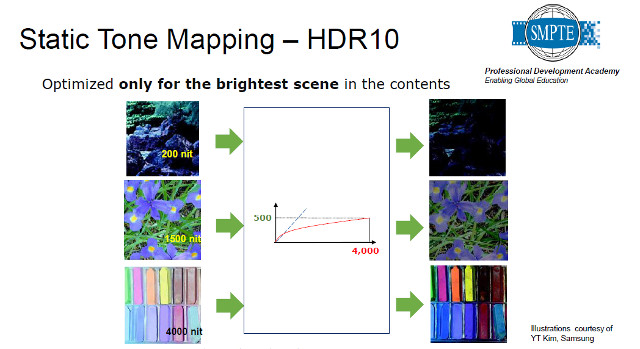

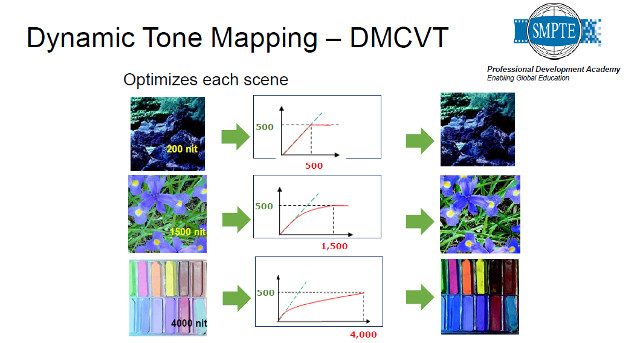

Co w ogóle posiada Dolby Vision “więcej” niż jest nam wstanie zaoferować HDR10? Zacznijmy od samych podstaw i wytłumaczenia kwestii związanych z poprawnym odtwarzaniem HDR. Gdyby wszystkie telewizory potrafiły wyświetlić jasność 10 000 cd/m2 , czyli maksimum tego co jest nam w stanie dostarczyć norma Ultra HD, to formaty premium takie jak Dolby Vision, HDR10+, czy Technicolor nie byłyby w ogóle potrzebne. Telewizory są jednak bardzo dalekie od tego (najlepsze OLEDy – około 700 nitów) i wymagają różnego rodzaju protez w celu określenia, czy wyświetlać dane odcienie jaśniej, ciemniej, czy nie wyświetlać ich wcale. Wszystko niesie za sobą pewne konsekwencje. Standard Dolby jest o tyle lepszy, że dostarcza dużo większą ilość dokładnych informacji jak wyświetlić każdą klatkę obrazu, w momencie gdy jej odtworzenie przekracza możliwości fizyczne telewizora.

|

|

Każdy telewizor posiada jednak inne możliwości fizyczne w zakresie odtwarzania jasności, jak i inne algorytmy mapowania w momencie gdy nie dysponuje dynamicznymi metadanymi (jak w standardzie Dolby). Oznacza to, że na każdej parze telewizorów różnica pomiędzy technologiami będzie zupełnie inna, w zależności od tego jak TV wspiera zarówno jedną jak i drugą normę. W przypadku gdy obsługuje któryś ze standardów z dynamicznymi metadanymi, w szczególności Dolby, to firma odpowiadająca za implementację funkcji ma większą kontrolę nad procesem. Nadal jednak mogą być zauważalne różnice między modelami pozornie podobnych telewizorów. Poza metadanymi, standard Dolby wnosi jeszcze 12 bitowe kodowanie barw (zamiast 10 bitowego), co potencjalnie może dać lepszą gradację odcieni obrazu.